Beetroot v1.6.5: Deine Zwischenablage kann jetzt Bilder lesen

Beetroot v1.6.5: AI Vision lässt deine Zwischenablage Bilder lesen (OCR, beschreiben, extrahieren, übersetzen). Hintergrund-AI-Job-Queue. Alle Provider in nativem Rust.

Das ist ein großes Release. Deine Zwischenablage kann jetzt Bilder lesen. Rechtsklick auf einen Screenshot, ein Foto oder einen Scan, und bitte die KI, Text zu extrahieren, zu beschreiben, was sie sieht, strukturierte Daten zu ziehen oder zu übersetzen. KI-Transforms laufen jetzt im Hintergrund, also friert nichts ein, während du wartest.

Auf einen Blick:

- AI-Vision-Transforms: analysiere Bilder mit 5 eingebauten Prompts plus eigenen

- Hintergrund-AI-Job-Queue: Transforms frieren die UI nicht mehr ein

- Alle KI-Anbieter in nativem Rust: schneller, zuverlässiger, keine CORS-Probleme

- Native Windows-Notifications: Ergebnisse poppen auf, wenn Beetroot ausgeblendet ist

- 11 Bug-Fixes

AI-Vision-Transforms

Wähle ein beliebiges Bild aus deiner Clipboard-Historie, Rechtsklick → AI, und such einen Vision-Prompt. Das Bild geht zu deinem KI-Anbieter und das Ergebnis landet in deiner Zwischenablage, bereit zum Einfügen.

Fünf eingebaute Vision-Prompts:

| Prompt | Was er tut |

|---|---|

| Read Text | OCR aus Fotos, Screenshots, handgeschriebenen Notizen |

| Describe Image | Liefert eine Textbeschreibung dessen, was im Bild ist |

| Extract Data | Zieht strukturierte Daten aus Tabellen, Belegen, Rezepten |

| Summarize Image | Schnelle Zusammenfassung visueller Inhalte |

| Translate Image Text | Übersetzt Text aus Bildern |

Du kannst auch eigene Vision-Prompts in den Settings anlegen.

Funktioniert mit allen Anbietern:

- Cloud: OpenAI GPT-5.4, Anthropic Claude (Haiku/Sonnet), Google Gemini 2.5, DeepSeek

- Lokal: Ollama (llava, bakllava, moondream), LM Studio

Selbst ein 4B lokales Modell auf deiner eigenen Hardware kann handgeschriebene Rezepte lesen. Keine Cloud, kein API-Key, keine Daten verlassen deinen Rechner.

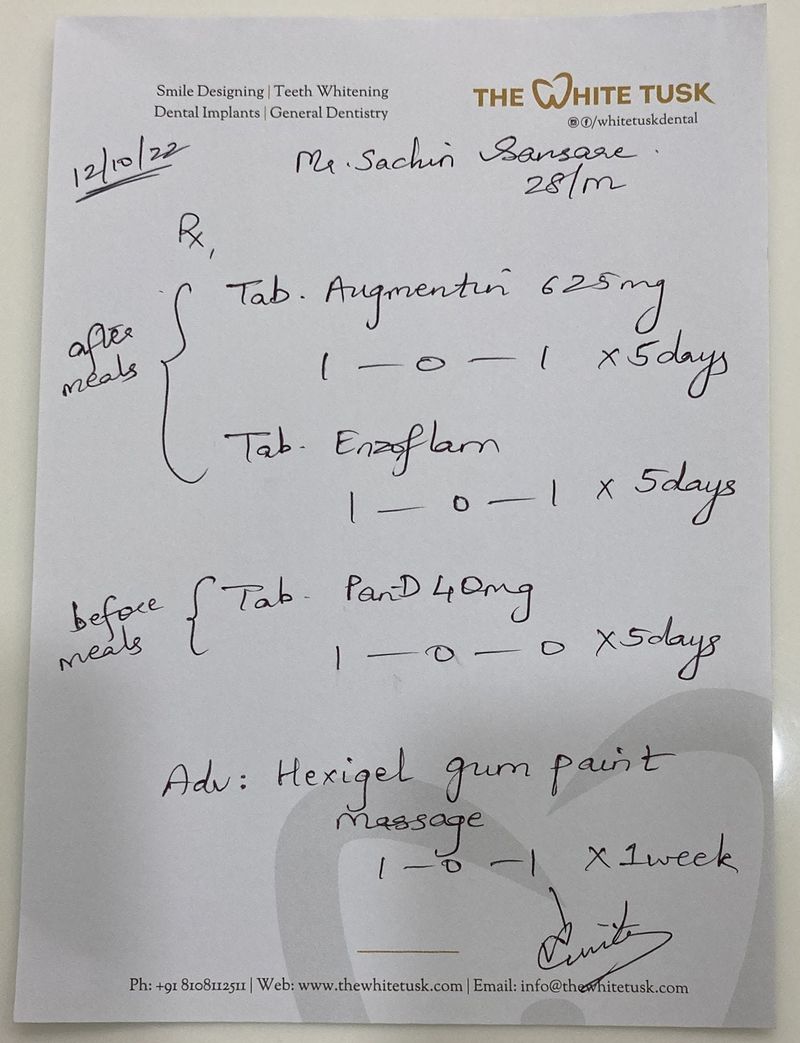

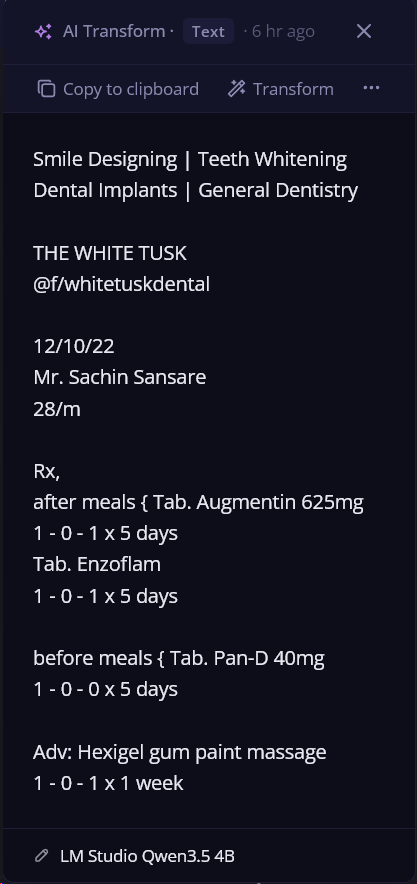

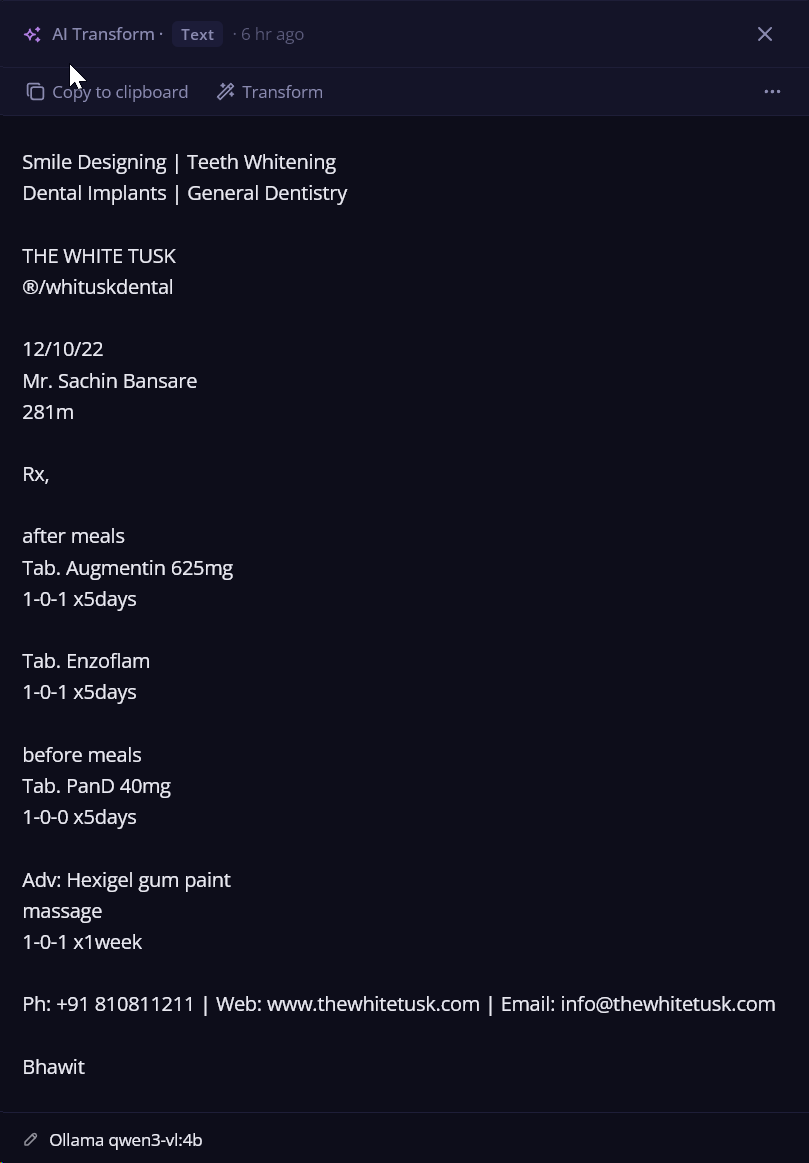

Real-World-Test: Arzt-Handschrift

Um AI Vision zu testen, habe ich ein zufälliges handgeschriebenes ärztliches Rezept aus Google Images gegriffen, eine Notiz aus einer Zahnarztpraxis mit kursiver Handschrift und medizinischen Abkürzungen. Das Zeug, das schwer zu lesen ist, sogar für Menschen.

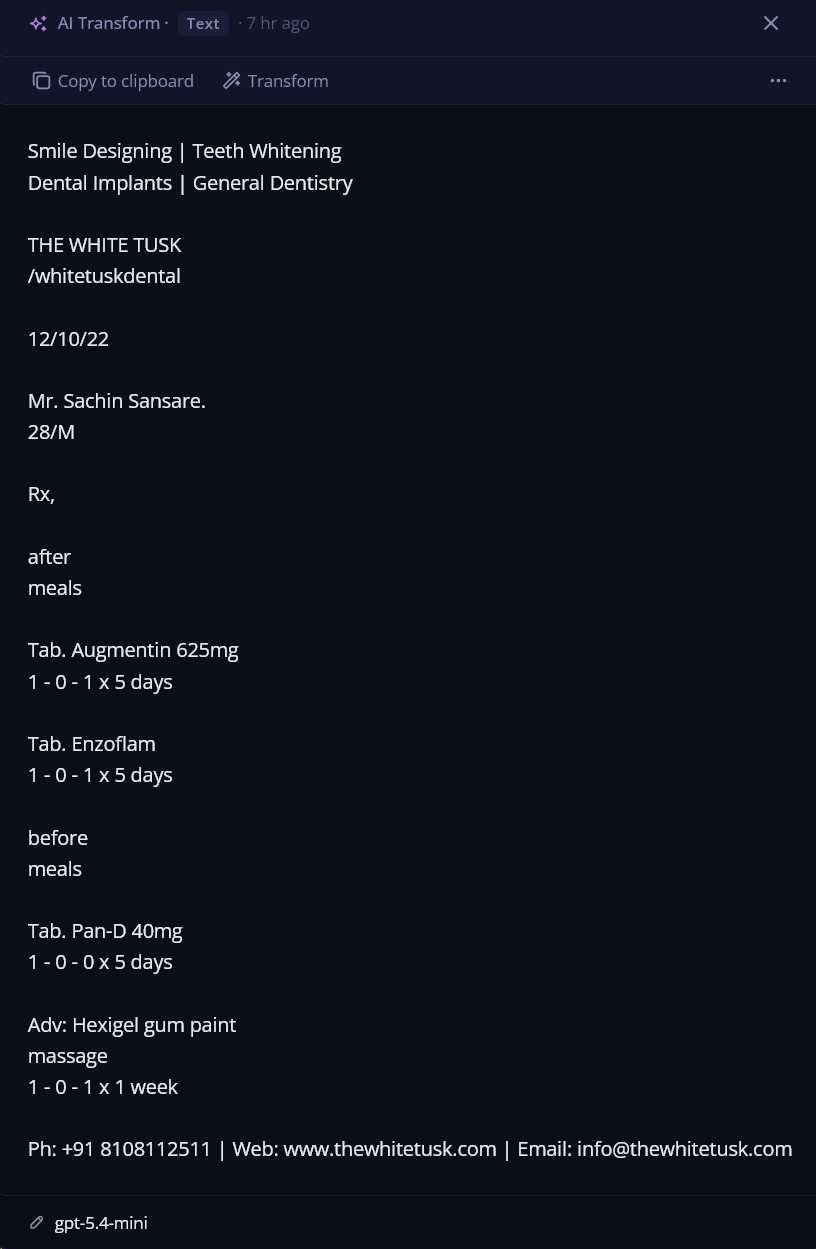

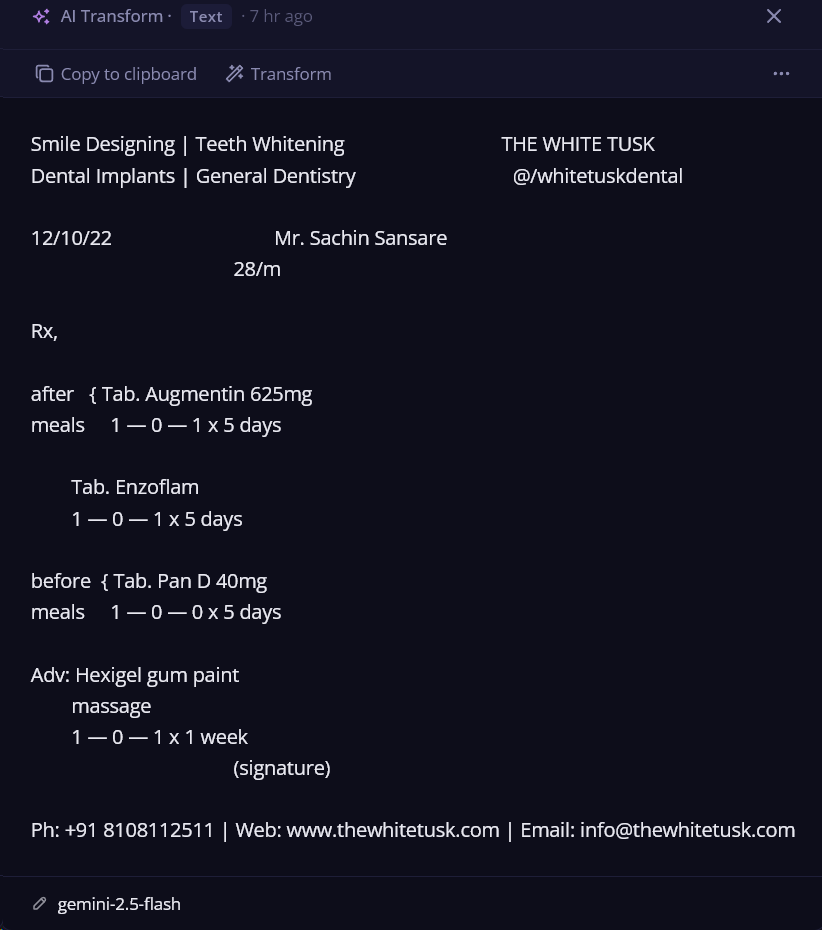

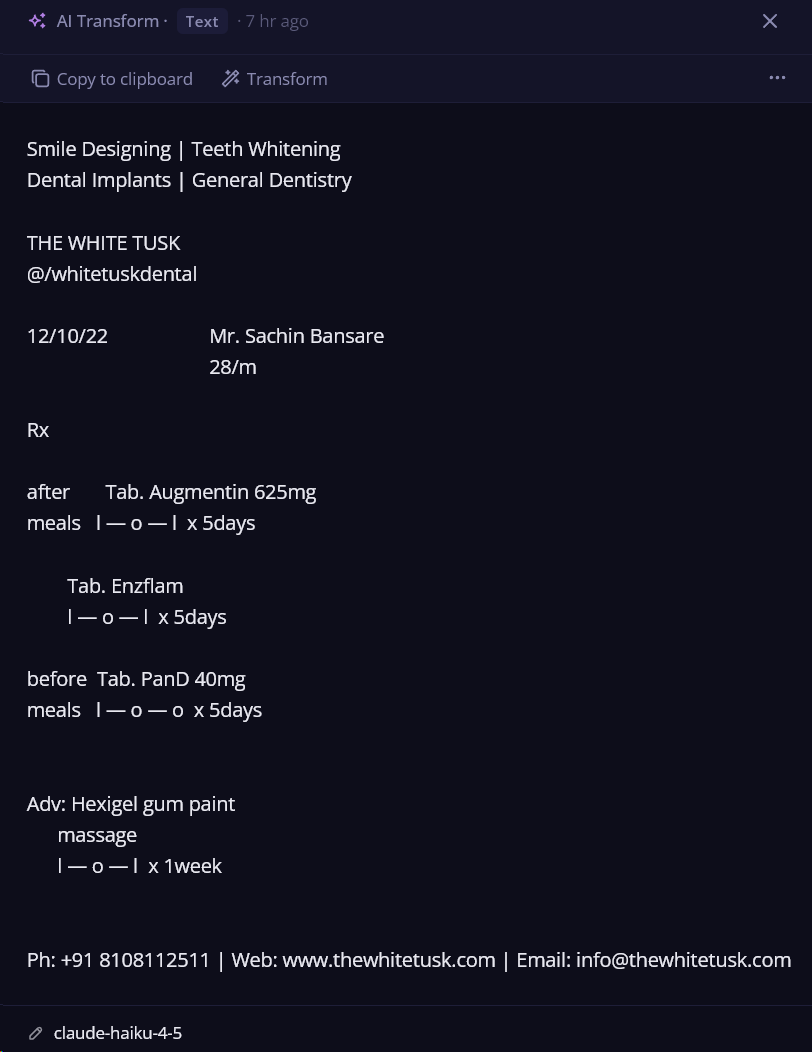

Ich habe es durch fünf verschiedene Modelle geschickt. So sah es aus:

| Modell | Typ | Geschwindigkeit | Qualität |

|---|---|---|---|

| GPT 5.4 mini | Cloud | Schnell | Exzellent. Akkurates Lesen der Kursivschrift, gute Formatierung |

| Gemini 2.5 Flash | Cloud | Sehr schnell | Exzellent. Gut strukturierter Output, behält Layout bei |

| Claude Haiku 4.5 | Cloud | Schnell | Exzellent. Sauberer Output, akkurat |

| LM Studio Qwen 3.5 4B | Lokal | Mittel | Sehr gut. Bestes lokales Modell, gute Formatierung |

| Ollama Qwen 3 4B | Lokal | Mittel | Gut. Solides OCR, weniger Formatierung |

Alle fünf lasen die Medikamente (Augmentin 625mg, Enzoflam, Pan-D 40mg), Dosierungen und Anweisungen korrekt. Aus kursiver Handschrift auf Papier.

Ein paar Ideen, was du damit machen kannst:

- Handschriftliche Notizen, Whiteboards, Sticky Notes lesen

- Daten aus Belegen, Rechnungen, Visitenkarten extrahieren

- OCR von Screenshots fremdsprachiger Apps

- Charts, Diagramme, technische Zeichnungen beschreiben

- Schilder, Menüs, Dokumente aus Fotos übersetzen

Hintergrund-AI-Job-Queue

KI-Transforms haben die UI früher 5–30 Sekunden eingefroren, während sie auf die Antwort warteten. Jetzt laufen sie im Hintergrund:

Vorher: Klick auf KI-Prompt → UI friert ein → Ergebnis erscheint

Jetzt: Klick auf KI-Prompt → Menü schließt sofort → weiterarbeiten → Notification poppt auf mit dem Ergebnis

Mehrere Transforms in die Queue stellen, sie laufen einer nach dem anderen. Wenn Beetroots Fenster ausgeblendet ist, bekommst du eine native Windows-Notification. Klick darauf, um Beetroot in den Vordergrund zu holen.

Alle KI-Anbieter in nativem Rust

Alle Cloud-API-Calls (OpenAI, Anthropic, Gemini, DeepSeek, Ollama) sind von Browser-JavaScript zu nativem Rust-Code gewandert:

- Keine CORS-Errors mehr

- Funktioniert, wenn das Fenster ausgeblendet ist (notwendig für Hintergrund-Transforms)

- Zuverlässiger mit konsistentem Error-Handling

- Schneller

Bug-Fixes

- KI-Menü, das nach einem Fehler manchmal hängenblieb, behoben

- Settings, die Font-Änderungen bei Cancel nicht zurücksetzten, behoben

- Error-Toast, der auf dunklen Themes unlesbar war, behoben

- Legacy-Modellnamen, die nicht korrekt migrierten, behoben

- 6 Fixes für Edge-Cases in Vision-Transforms

Update

Beetroot bietet das Update automatisch an. Oder v1.6.5 von GitHub herunterladen.