Beetroot v1.5.0: Fünf KI-Anbieter, smartere App-Erkennung

Beetroot unterstützt jetzt OpenAI, Gemini, Claude, DeepSeek und lokale Modelle. Plus AI-Sparkles, Ollama-Presets und smarteres Tracking der Quell-App.

Die erste Version von Beetroot sprach nur mit OpenAI. Das hat mich gestört. Ich habe das Ding gebaut, damit es mein Clipboard-Manager ist, und an einen einzigen KI-Anbieter gebunden zu sein, fühlte sich falsch an. Nicht jeder will seine Zwischenablage zu OpenAI schicken, nicht jeder will pro Token zahlen, und manche wollen gar keine Cloud-KI.

Also habe ich die hartcodierte OpenAI-Integration herausgerissen und durch ein richtiges Provider-System ersetzt. Das Ergebnis: fünf KI-Anbieter, volle Unterstützung für lokale Modelle und eine Settings-Seite, die endlich Sinn ergibt.

Auf einen Blick:

- Größte Änderung: 5 KI-Anbieter statt nur OpenAI, inklusive Gratis-Variante

- Für Privacy-Fans: vollständig lokale KI über Ollama, LM Studio oder einen beliebigen OpenAI-kompatiblen Endpoint

- Neuer visueller Hinweis: Sparkle-Icon markiert KI-transformierte Clips, Vorschau zeigt Prompt und Modell

- Besseres App-Tracking: Java-, Python- und Electron-Apps zeigen jetzt echte Namen und Icons

- Security-Fix: der lokale KI-Endpoint validiert URLs gegen SSRF

- Breaking Changes: keine. Deine Prompts, Settings und Historie bleiben erhalten

Wer sollte jetzt updaten: alle, die KI-Transforms täglich nutzen, einen kostenlosen Anbieter (Gemini) wollen, vollständig lokale Verarbeitung brauchen oder Java- und Electron-Apps wie IntelliJ verwenden.

Warum eine funktionierende KI-Schicht herausreißen?

Die OpenAI-Integration in v1.4 lief gut. Aber sie hatte drei Probleme, gegen die ich immer wieder gelaufen bin:

- Kostenbarriere. Jeder KI-Transform, selbst eine schnelle Grammatik-Korrektur, kostete Tokens. Manche Nutzer kopieren Dutzende Clips am Tag. Das summiert sich.

- Datenschutz. Clipboard-Daten können alles Mögliche enthalten: Passwörter, Code-Snippets, persönliche Nachrichten. Das alles an einen einzigen Cloud-Anbieter zu schicken, war für viele kein gutes Gefühl.

- Single Point of Failure. OpenAI fällt aus, deine KI-Transforms stehen still. Kein Fallback, keine Alternative.

Die Lösung war nicht "mehr Anbieter hinzufügen". Sondern die KI-Schicht so umzubauen, dass Anbieter austauschbar sind. Jeder Anbieter teilt sich jetzt dieselbe Prompt-Bibliothek, dasselbe Rechtsklick-Transform-Menü, dasselbe Settings-Pattern. Der Wechsel des Anbieters ändert nichts daran, wie du Beetroot benutzt. Es ändert nur, wohin der KI-Request geht.

Fünf KI-Anbieter zur Auswahl

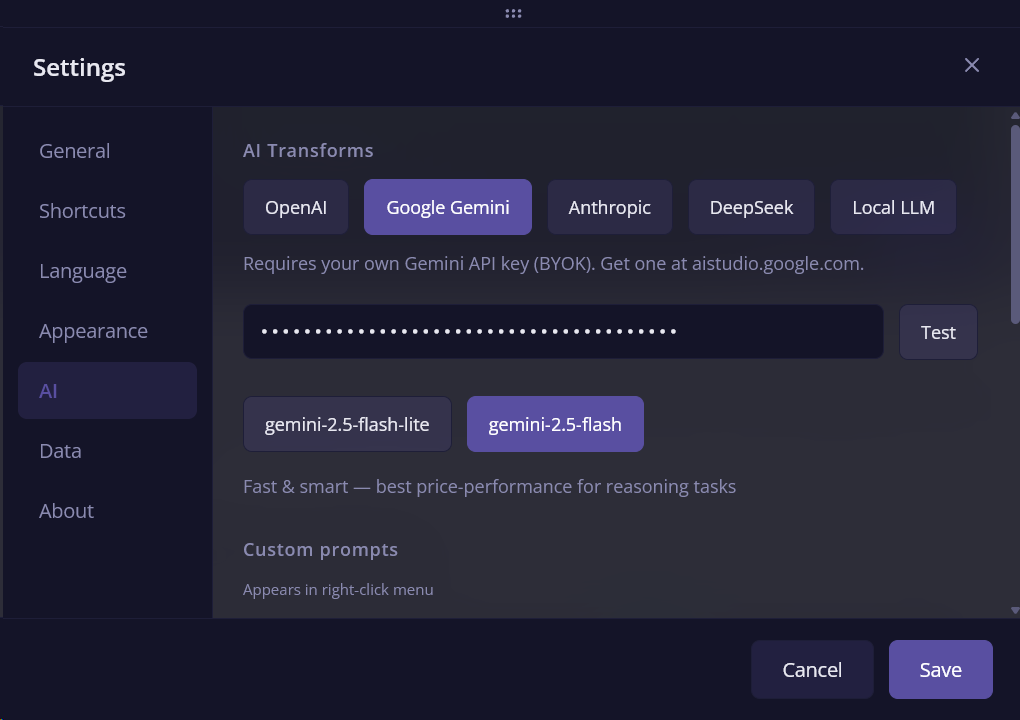

Jeder Anbieter nutzt Bring Your Own Key. API-Key einfügen, auf Test klicken, Modell wählen, fertig.

| Anbieter | Modelle | Preise |

|---|---|---|

| OpenAI | gpt-5-nano, gpt-5-mini | Pay per use |

| Google Gemini | gemini-2.5-flash-lite, gemini-2.5-flash | Free Tier verfügbar |

| Anthropic Claude | claude-haiku-4-5, claude-sonnet-4-6 | Pay per use |

| DeepSeek | deepseek-chat V3, deepseek-reasoner R1 | Sehr günstig |

| Local LLM | Beliebige Modelle über Ollama / LM Studio | Kostenlos, läuft auf deinem Rechner |

Der Gemini Free Tier ist das große Ding. Vor v1.5.0 hieß "KI-Transforms benutzen" immer "pro Token zahlen". Jetzt kannst du Grammatik-Fixes, Übersetzungen und Zusammenfassungen ohne einen Cent nutzen. Hol dir einfach einen kostenlosen Key bei AI Studio, füge ihn ein, fertig. DeepSeek ist eine weitere günstige Option, wenn du etwas mehr Power brauchst als der Free Tier, aber nicht die OpenAI-Preise zahlen willst.

Ein Anbieterwechsel dauert etwa zehn Sekunden. Settings öffnen, Tab auswählen, Key einfügen. Keine Neuinstallation, kein Neustart. Alle Anbieternamen und Beschreibungen sind in allen 26 unterstützten Sprachen übersetzt.

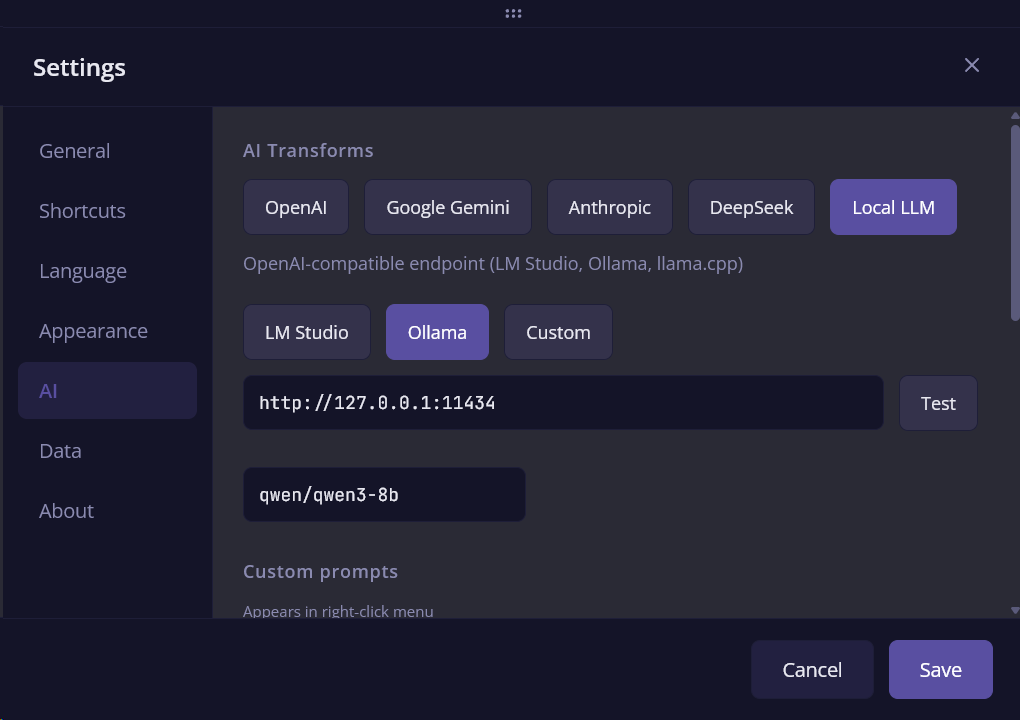

Lokale Modelle: KI-Transforms vollständig offline

Wenn Ollama auf deinem Rechner läuft, erkennt Beetroot es automatisch. Die Settings-Seite hat dedizierte Presets für LM Studio, Ollama und Custom Endpoints. Eines auswählen und die URL füllt sich automatisch. Ollama geht noch einen Schritt weiter: es lädt deine installierten Modelle automatisch, wenn du Settings öffnest, sodass du aus einer Liste auswählst, statt Modellnamen zu tippen.

Ich nutze das selbst mit qwen3-8b lokal und es macht Grammatik-Fixes und Übersetzungen erstaunlich gut. Nicht so schnell wie eine Cloud-API, aber deine Daten verlassen deinen Rechner nie. Das zählt, wenn du den ganzen Tag sensible Inhalte kopierst.

Jeder OpenAI-kompatible Endpoint funktioniert ebenfalls. Wenn du llama.cpp, vLLM oder etwas anderes laufen lässt, das das OpenAI-Protokoll spricht, zeig Beetroot einfach darauf.

AI-Sparkles: sehen, was transformiert wurde

Vor diesem Update gab es keine Möglichkeit, einen KI-transformierten Clip auf den ersten Blick vom Original zu unterscheiden. Die transformierte Version saß einfach in der Historie und sah aus wie jeder andere Clip.

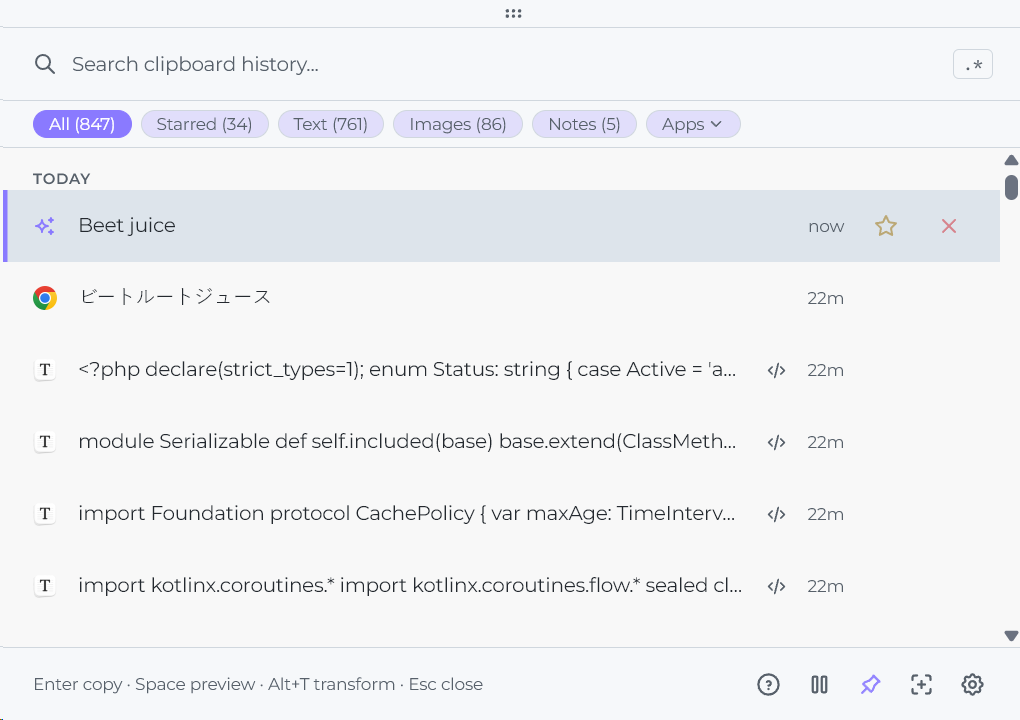

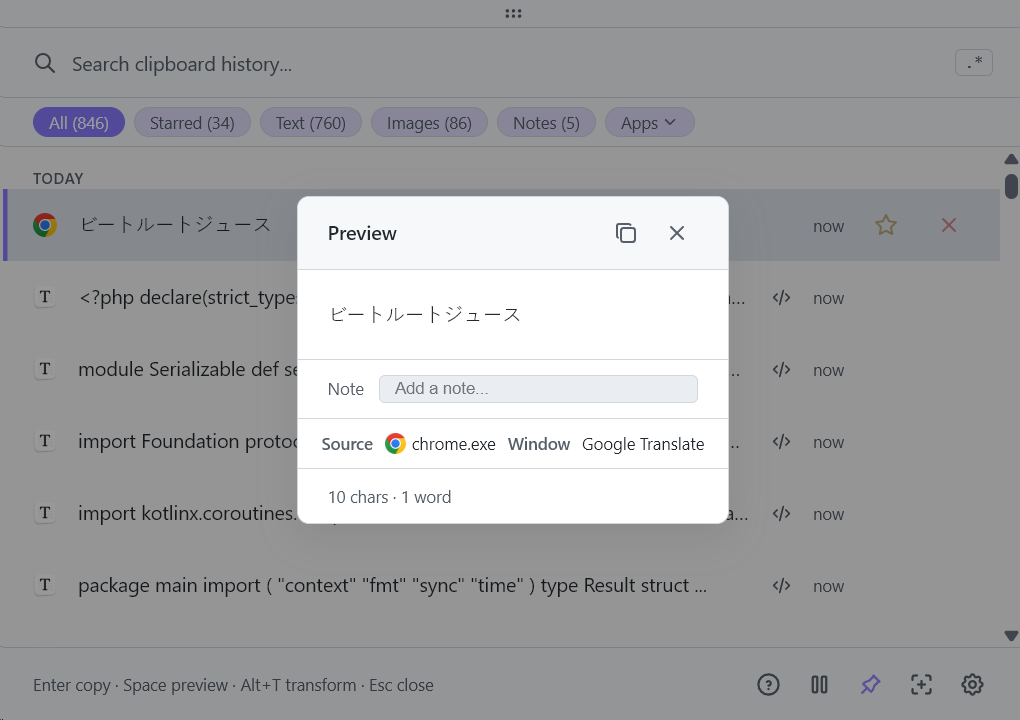

Jetzt zeigen KI-generierte Einträge ein Sparkle-Icon, sowohl in der Hauptliste als auch in der Apps-Filter-Seitenleiste. Du kannst durch hunderte Clips scrollen und sofort erkennen, welche KI-verarbeitet wurden.

Es gibt mehr: Wenn du Space drückst, um einen KI-transformierten Clip in der Vorschau anzuzeigen, siehst du jetzt Prompt-Name und Modell, das verwendet wurde. So etwas wie "Any to English · gpt-5-nano" direkt in der Vorschau. Du weißt also genau, was mit dem Clip passiert ist und welche KI ihn produziert hat.

Smartere Erkennung der Quell-App

Beetroot hat schon immer getrackt, aus welcher Anwendung ein Clip kam. Aber für bestimmte Apps war die Erkennung unzuverlässig, und das Muster war konsistent:

| Vor v1.5.0 | Nach v1.5.0 |

|---|---|

java.exe | IntelliJ IDEA |

python.exe | Jupyter Notebook |

electron.exe | Obsidian |

| Letztes aktives Fenster | Beetroot (beim Kopieren aus der Vorschau) |

Java-Apps wie IntelliJ und Screaming Frog zeigten generische Prozessnamen, weil die Windows-Clipboard-API den Prozess meldet, nicht das Fenster. Python-Apps waren aus demselben Grund unsichtbar. Electron-Apps waren Glückssache, je nachdem, wie sie ihre Window Class registrierten.

Ich habe die App-Namensauflösung neu geschrieben, sodass sie den tatsächlichen Window-Titel und das Icon ausliest, statt sich auf den Prozessnamen zu verlassen. Jetzt zeigen Java-, Python- und Electron-Apps alle ihr echtes Icon und den richtigen Namen.

Noch ein Fix: Kopieren aus Beetroots eigenem Vorschau-Panel zeigt jetzt korrekt Beetroot als Quell-App, statt des letzten aktiven Fensters. Window-Titel und Notizen werden in der Clipboard-Liste außerdem als Untertitel angezeigt, sodass du mehr Kontext hast, ohne die Vorschau zu öffnen.

Stabilität und UX-Fixes

Fenster bleibt nach KI-Transform offen. Wenn du Beetroot angeheftet hattest (always on top), wurde es nach dem Transformieren eines Clips geschlossen. Jetzt kopiert es das Ergebnis und bleibt offen.

API-Key-Test hängt. Der Test-Button drehte sich für immer, wenn die API nicht erreichbar war. Jetzt läuft er nach einigen Sekunden ab und sagt dir, was schiefgelaufen ist: falscher Key, Netzwerkfehler oder Anbieter offline.

Security: Endpoint-Validierung

Das Eingabefeld für den lokalen KI-Endpoint in den Settings akzeptierte jede beliebige URL, einschließlich interner Netzwerkadressen. Wenn jemand Zugriff auf deine Beetroot-Config hatte, konnte er den Endpoint auf http://169.254.169.254 oder einen anderen internen Service zeigen lassen und KI-Transforms als Proxy nutzen, um interne APIs anzusprechen.

Das ist ein klassischer SSRF-Vektor (Server-Side Request Forgery). In v1.5.0 validiert das Endpoint-Feld URLs jetzt gegen eine Blockliste mit privaten und reservierten IP-Bereichen. Nur routbare Adressen und localhost (für lokale Modelle) werden akzeptiert.

Wer war betroffen: nur Nutzer, die einen Custom Local LLM Endpoint konfiguriert hatten. Cloud-Anbieter (OpenAI, Gemini, Claude, DeepSeek) waren nie betroffen, ihre Endpoints sind hartcodiert. Nach dem Update ist keine Aktion deinerseits nötig.

Was sich nicht geändert hat

Ein paar Dinge, nach denen Leute gefragt haben:

- Deine Prompt-Bibliothek bleibt erhalten. Alle Custom Prompts, Modell-Präferenzen und KI-Einstellungen bleiben genau so, wie sie waren.

- Das Rechtsklick-Transform-Menü ist gleich. Gleiche Shortcuts, gleicher Flow. Nur der Anbieter läuft im Hintergrund anders.

- Cloud bleibt optional. Wenn du keinen KI-Anbieter konfigurierst, funktioniert Beetroot genau wie vorher. Clipboard-Manager ohne KI.

- Daten bleiben lokal. Die SQLite-Datenbank, deine Clips, deine Historie. Nichts wurde verschoben. KI-Transforms senden nur den ausgewählten Text, wenn du dich für eine Transformation entscheidest.

Update

Beetroot bietet beim nächsten Start automatisch das Update an. Oder v1.5.0 manuell herunterladen.

Das ist das Release, das Beetroots KI-Schicht flexibel macht, statt sie an einen Anbieter zu binden. Update, wenn du kostenlose KI mit Gemini willst, vollständig offline arbeitende Transforms mit lokalen Modellen, oder besseres Tracking der Quell-App.